ROS2基础开发

实验04-ROS2 相机应用

材料准备:一块RDK-X5主板,一个USB接口摄像头

1. 实验步骤

(1)摄像头连接检查

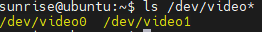

将usb摄像头连接开发板,并运行ls /dev/video*,检查摄像头连接 ,

, 如图所示摄像头连接成功。(此处采用video0为例)

如图所示摄像头连接成功。(此处采用video0为例)

(2)唤醒摄像头

- 运行

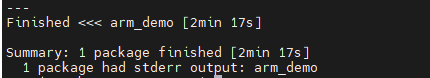

cd ~/ros2_ws && colcon build --packages-select arm_demo,进入ros2工作空间并编译arm_demo工作包。

2.随后运行source ~/ros2_ws/install/setup.bash # 激活工作空间

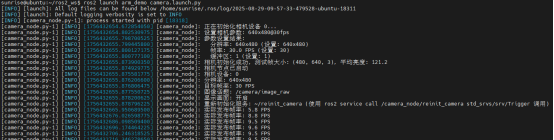

3.最后运行ros2 launch arm_demo camera.launch.py #运行camera.launch.py文件(此处摄像头使用默认video0,如若要修改,修改launch文件默认值 在 camera.launch.py 的第26行)

此时会看到终端打印信息:

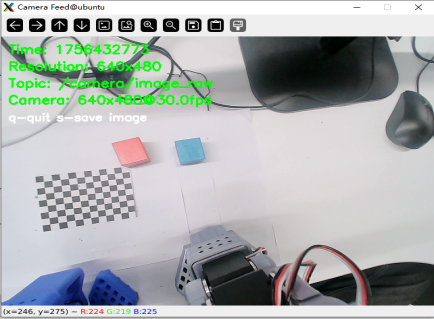

并且窗口出现实时画面

到这一步摄像头就已经成功被唤醒啦!